Vous tapez « carte de visite virtuelle » sur Google. Les résultats affichent deux produits totalement différents. D’un côté, des applications mobiles gratuites qui stockent vos coordonnées dans un QR code. De l’autre, des cartes physiques équipées de puces NFC. Même nom commercial, même promesse marketing (« fini le papier ! »), mais rien à voir dans la pratique.

Au-delà de cette confusion commerciale se cache un vrai débat. La carte de visite connectée transforme-t-elle simplement un support papier en support digital ? Ou bouleverse-t-elle fondamentalement notre façon de créer et d’entretenir nos réseaux professionnels ?

Évolution ou révolution ? La réponse dépend de ce qu’on observe. Le geste d’échanger une carte reste identique mais pour la première fois, ce geste crée un lien permanent et actualisable. Simple amélioration technique ou changement de paradigme du networking ?

Application, NFC ou wallet : derrière le terme, trois réalités

Le terme « carte de visite virtuelle » désigne trois produits distincts.

- Applications mobiles pures : vous téléchargez une app, vous générez un QR code. Gratuit, aucun support physique. Vous montrez votre écran, on scanne.

- Carte physique NFC : un support en PVC, bois ou métal avec puce NFC et QR code intégrés. Vous présentez la carte, on approche son smartphone, le profil digital s’ouvre.

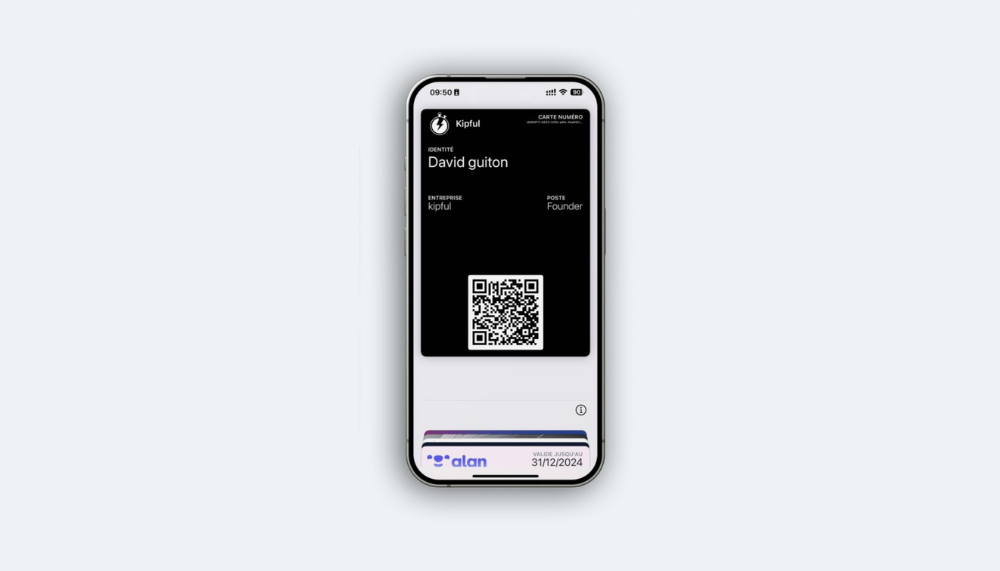

- Wallet digital : votre carte existe dans Apple Wallet ou Google Pay. QR code intégré au système, aucune app à télécharger.

Trois solutions, trois usages différents. Un commercial qui fait 40 rendez-vous par mois n’a pas les mêmes besoins qu’un freelance qui fait du networking deux fois par an.

Pourquoi les applications gratuites échouent sur le terrain ?

En théorie, l’application mobile gratuite résout tout. En pratique, trois obstacles surgissent systématiquement.

- Premier obstacle : le moment gênant. Vous sortez de réunion, vous tendez votre écran pour montrer votre QR code. L’autre personne doit sortir son téléphone, ouvrir son appareil photo, scanner. Trente secondes qui cassent le flow de la conversation.

- Deuxième obstacle : l’oubli systématique. Vous rentrez d’un salon avec 15 QR codes scannés. Combien allez-vous vraiment recontacter ?

- Troisième obstacle : le signal envoyé. Tendre son smartphone dans une réunion renvoie une image amateur. Plus de 70% des professionnels jugent une entreprise sur la qualité de sa carte de visite.

Sur le papier, les applications mobiles fonctionnent pour des échanges ultra-ponctuels mais our le networking régulier en B2B, le taux d’abandon pourrait atteindre 85% après trois mois.

La carte de visite virtuelle physique : le phygital qui marche

La carte physique équipée NFC et QR code résout les trois problèmes précédents.

- Question prix : à partir de 49e selon le matériau. Vous gardez UNE carte à vie. Coordonnées modifiables en ligne gratuitement, sans limites. Comparé aux 500 euros annuels de réimpression pour un commercial actif, le retour sur investissement arrive dès la première année.

- Question geste : identique à la carte papier. Vous la sortez, vous la tendez. L’autre personne approche son smartphone. La puce NFC déclenche l’ouverture du profil. Compatible iOS et Android sans app. Temps total : 5 secondes.

- Question perception : cette carte de visite virtuelle envoie un double signal. Matérialité du support, modernité de la technologie. Dans les secteurs traditionnels (juridique, immobilier, conseil), ce positionnement hybride fonctionne mieux que le tout-digital.

Les retours terrain confirment trois bénéfices : mémorabilité (les contacts gardent la carte), suivi (statistiques de consultation), professionnalisme (impact lors des premiers échanges).

Une simple amélioration du papier ?

Soyons concrets et analysons ce qui change vraiment avec ce type de produit. Le geste reste identique à celui pratiqué depuis le début des cartes de visite : vous sortez une carte de votre poche, vous la tendez à votre interlocuteur, vous échangez quelques mots. Le rituel social n’a pas bougé d’un millimètre.

L’objet physique persiste. Vous conservez toujours un support tangible dans votre portefeuille, la carte de visite virtuelle avec NFC ne supprime pas la matérialité, elle l’améliore. On passe du bristol cartonné au PVC connecté, du papier au métal gravé. Mais on reste dans la logique du support physique palpable.

Les codes sociaux demeurent inchangés. Dans les environnements professionnels traditionnels (cabinets d’avocats, études notariales, sociétés de conseil), tendre une belle carte reste un marqueur de sérieux. Comme déjà mentionné plus tôt, une majorité des professionnels jugent une entreprise sur la qualité de sa carte de visite. Cette perception ne change pas avec la technologie NFC. Au contraire, elle se renforce.

Le marché des applications mobiles pures le prouve. Malgré des millions investis en marketing, elles restent ultra-marginales dans le networking B2B classique. Pourquoi ? Parce qu’elles suppriment le rituel physique et le rituel compte autant que l’information échangée.

La carte de visite virtuelle et physique s’inscrit donc dans une continuité. On améliore l’outil (mise à jour instantanée, richesse du profil digital), mais on conserve l’usage ancestral. Évolution technologique, pas révolution comportementale.

Une vraie rupture dans le networking ?

Pour la première fois dans l’histoire du networking, échanger une carte ne crée plus un transfert d’information figé. Cela ouvre un canal permanent.

Avant : vous donniez une carte papier. Votre contact la rangeait (ou la jetait). Si vos coordonnées changeaient, cette carte devenait obsolète. Relation rompue.

Maintenant : vous présentez votre carte de visite virtuelle. Votre contact scanne. Trois mois plus tard, vous changez de poste. Son smartphone affiche automatiquement vos nouvelles fonctions. Le lien reste actif.

Le vrai basculement se joue ailleurs. Quand vous donnez votre carte, vous n’échangez plus simplement des coordonnées figées. Vous ouvrez un canal permanent. Votre contact garde accès à votre profil, qui évolue avec vous. Trois mois plus tard, vous changez de poste ? Son smartphone affiche automatiquement vos nouvelles fonctions. Vos 200 contacts des trois dernières années restent connectés à votre version actualisée, sans que vous ayez à les relancer un par un.

La différence avec le papier va encore plus loin. Votre carte génère des données : qui a consulté votre profil, quand, quels documents ont été téléchargés. Vous identifiez les contacts actifs et vous relancez au bon moment. Pendant ce temps, votre profil digital embarque l’intégralité de votre écosystème professionnel (portfolio, catalogues, prise de rendez-vous, vidéos) là où le bristol papier peine à afficher 50 caractères.

Le taux de réachat à 91% confirme cette transformation. Une fois adopté, on ne revient jamais au papier. Ce n’est pas le signe d’une amélioration technique, c’est un changement profond de comportement.

Alors, évolution ou révolution ?

Les deux idées tiennent la route. Et c’est justement là que réside l’intelligence de la carte de visite virtuelle phygitale.

- C’est une évolution parce que le rituel social ne change pas. Vous tendez toujours une carte. L’objet physique persiste et les codes du networking B2B restent identiques. Le support s’améliore, mais le geste perdure. Aucune friction, aucune rupture avec des années de pratiques professionnelles.

- C’est une révolution parce que la nature de la relation bascule. On passe du transfert d’information figé à la connexion durable. Vos contacts accèdent à un profil vivant qui évolue avec vous. Cette permanence redéfinit fondamentalement la gestion de réseau à long terme. Le canal reste ouvert, même après trois ans.

La vraie question n’est donc plus « évolution ou révolution ? » Elle devient : quelle solution correspond vraiment à votre usage ? Votre carte actuelle vous sert-elle encore ? Si vous réimprimez tous les six mois, si vous perdez des contacts après les salons, si votre réseau dort dans des tiroirs, vous avez probablement votre réponse.